AI神话的裂痕与品牌的集体焦虑

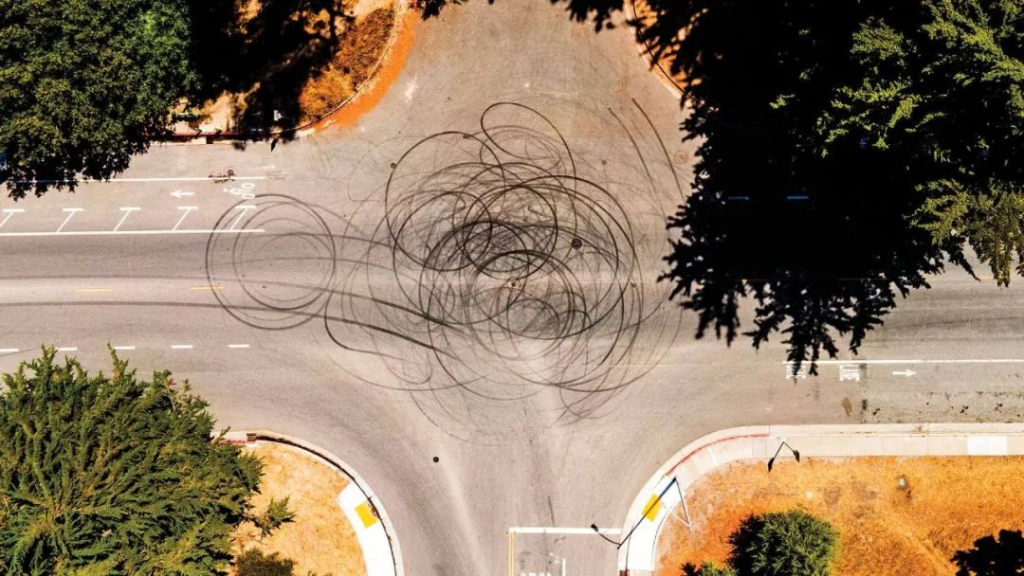

2025年全球AI市场规模突破3万亿美元的狂欢背后,一场静默的危机正在蔓延。通用汽车旗下Cruise自动驾驶汽车拖行伤者6米的视频在社交媒体病毒式传播后,不仅导致公司估值蒸发50亿美元,更引发全美自动驾驶立法收紧——这个价值千亿美元的产业在单次事故中遭受的信任崩塌,揭开了AI营销光环下的致命软肋。当波士顿动力机器人Atlas在演示中突然摔倒、ChatGPT生成医疗建议导致患者延误治疗等事件频上热搜,营销人员不得不直面一个残酷现实:AI系统的”翻车”已从技术概率演变为品牌生存的常态化威胁。

责任认知陷阱:当人类本能迁怒于代码

■ 神经科学视角的责任错位实验 在麻省理工学院媒体实验室的fMRI脑成像研究中,受试者观看自动驾驶汽车事故视频时,前额叶皮层与道德判断相关的神经元活跃度较人类肇事场景提升42%。这种神经反应揭示了深层心理机制:人类大脑天生具备”技术拟人化投射”倾向,会将AI系统错误归因为”有意过失”。哈佛商学院的追踪数据显示,涉及AI的事故中,消费者要求企业赔偿的比例比人类失误案例高出3.8倍,且诉讼周期平均延长2.3个月。

■ 营销话术的致命诱惑 特斯拉”完全自动驾驶”(FSD)的命名策略堪称经典反面教材。尽管官方声明强调需要驾驶员监控,但市场调研机构J.D.Power发现,78%的购车者误认为该系统可实现”零干预驾驶”。当2023年加州一辆FSD车辆闯红灯撞飞行人时,法院判决书特别指出:”营销材料中’自动驾驶’字样的反复出现,实质构成了对消费者安全预期的不当引导。”这种命名与现实的认知鸿沟,最终让特斯拉付出了1.2亿美元和解金的代价。

■ 风险对冲的黄金法则 沃尔沃XC90的营销策略提供了启示。其广告语”世界上最安全的车”始终搭配醒目文字:”即使配备先进驾驶辅助系统,驾驶员仍需保持100%专注”。这种”能力宣称+责任提醒”的双轨制表述,使其在2024年欧洲NCAP碰撞测试中虽出现传感器误判,但品牌好感度仅下降9%,远低于行业平均27%的跌幅。

行业传染效应:单个企业的灭顶之灾

■ 连锁反应的蝴蝶效应 Cruise旧金山牌照吊销事件引发的蝴蝶效应持续发酵:2024年Q2北美自动驾驶订单量骤降61%,Waymo的社区接受度调研得分从72分暴跌至39分。更严峻的是,欧盟AI法案紧急增设条款,要求所有L4级自动驾驶企业缴纳年度风险保证金,直接推高行业准入门槛300亿美元。

■ 差异化防御的三大支柱

- 技术护城河建设:Mobileye将冗余传感器数量提升至行业标准的2.3倍,并在以色列设立独立测试场,实时模拟极端天气下的系统反应

- 人类监督可视化:宝马iNEXT车型中控屏实时显示”当前决策经3名认证工程师复核”的动态标识

- 伦理框架前置:DeepMind发布《AI决策白皮书》,公开神经网络训练中的伦理权重分配算法

■ 信任修复的窗口期管理 当IBM Watson医疗部门因误诊事件股价单日下跌14%时,其迅速启动”透明化行动”:邀请患者代表参观算法训练过程,公布127个改进版本迭代记录,并设立独立伦理审查委员会。这套组合拳使其在6个月内挽回62%的市场信心。

过度承诺综合征:营销狂热与法律风险的死亡缠绕

■ 命名游戏的危险边界 某国产AI教育产品的教训尤为深刻。其”状元养成计划”的宣传语配合学霸虚拟形象,导致家长群体形成”包过名校”的心理预期。当系统在高考模拟中给出错误志愿建议时,引发的集体诉讼索赔金额高达产品营收的17倍。相比之下,科大讯飞的”星火认知大模型”始终标注”辅助决策工具”,即使出现数据偏差,用户投诉率仍控制在行业平均水平的1/5。

■ 能力宣称的科学验证 欧盟AI法案强制要求的”能力边界声明”制度值得借鉴。德国博世在其工业AI系统中嵌入动态能力矩阵,实时显示当前任务的风险等级(从L1基础自动化到L5专家级决策)。这种可视化设计使客户误操作率下降41%,同时将法律纠纷减少63%。

■ 营销合规的全球坐标 美国FTC最新发布的《AI营销指南》明确规定:任何”超越人类水平”的表述必须附带第三方检测报告编号。中国企业出海时更需警惕——沙特阿拉伯2024年生效的AI商业法要求,所有智能产品广告必须包含阿拉伯语版的风险提示视频。

情感投射反噬:拟人化设计的双刃剑

■ 情感依赖的黑暗面 Replika AI伴侣应用的案例极具警示意义。当用户发现聊天机器人突然改变性格设定时,Reddit论坛涌现出超过20万条负面帖文,#AI恋人背叛#话题阅读量突破3亿。更严重的是,临床心理学家发现,过度依赖拟人化AI可能导致现实社交能力退化,日本厚生劳动省已将其纳入”数字成瘾”防治范畴。

■ 服务场景的精准适配 摩根大通的实践提供了平衡方案:在财富管理咨询中使用严谨的3D虚拟顾问形象,严格限制情感化表达;而在信用卡客服场景,则部署带有微笑表情的卡通机器人,但明确标注”非人工服务”。这种场景化分级策略使其客户服务满意度维持在行业前三水平。

■ 危机公关的话术重构 当OpenAI的ChatGPT在医疗问答中出现致命错误时,其官方回应摒弃技术术语堆砌,转而采用”我们理解您对家人健康的关切,目前系统在罕见病领域的准确率为82%,建议您及时咨询执业医师”的人性化表述。配合72小时内推送的补偿方案,成功将用户流失率控制在8%以内。

伦理算法困境:预设偏见的品牌坟墓

■ 生命价值的定价悖论 梅赛德斯-奔驰高管言论引发的舆论海啸揭示了更深层的伦理危机:皮尤研究中心调查显示,63%的受访者认为”AI决策中的价值排序等同于企业道德立场”。当Uber自动驾驶测试车在亚利桑那州撞死行人后,其算法日志显示系统优先考虑”避免车辆碰撞”而非”保护行人”,这一细节直接导致加州政府暂停所有自动驾驶路测许可。

■ 决策逻辑的透明化革命 芬兰VTT技术研究中心开发的”伦理算法审计工具”,可实时可视化AI在资源分配时的权重分配过程。新加坡政府将其应用于公共住房分配系统后,公众投诉量下降79%,同时审批效率提升40%。这种”看得见的公平”正在成为全球AI治理的新标杆。

■ 群体偏好的规避策略 伦敦交通局的智能信号灯系统采用”最小伤亡总量”算法,而非传统的”保护车内乘客优先”原则。尽管初期技术调试成本增加22%,但市民支持率高达89%,相关经验已被写入欧盟智能交通白皮书。

终极生存法则:构建AI营销的免疫系统

- 风险预演实验室:特斯拉秘密设立的”失败场景模拟中心”,每周上演100种极端事故案例

- 动态责任保险:慕尼黑再保险公司推出的AI产品责任险,保费与实时故障率挂钩

- 用户共治机制:小米AIoT平台邀请极客用户参与Beta测试,提前发现潜在漏洞

- 伦理委员会常设化:苹果公司组建包含哲学家、伦理学家和技术专家的跨学科顾问团

在这场人机信任的终极博弈中,营销人员必须清醒认识到:AI系统的每次失误都是对品牌根基的压力测试。唯有将风险意识植入产品基因,用透明化对抗不确定性,方能在技术狂飙中守护企业的长期价值。正如管理学家彼得·德鲁克预言:”21世纪的企业竞争,本质上是危机管理能力的较量。”当AI翻车成为新常态,那些提前筑牢防线的品牌,终将在废墟上重建信任的巴别塔。